LLMの返事がテキストの壁だった問題を、2行のコードで解決するAPIが出てきた

LLMに「先月の売上を見せて」と聞くと、数字の羅列がMarkdownテーブルで返ってくる。本当はグラフがほしい。「旅行プランを立てて」と頼むと、箇条書きの壁。本当はカード形式で比較したい。

LLMは賢くなった。でも出力が全部テキストという制約は変わっていない。

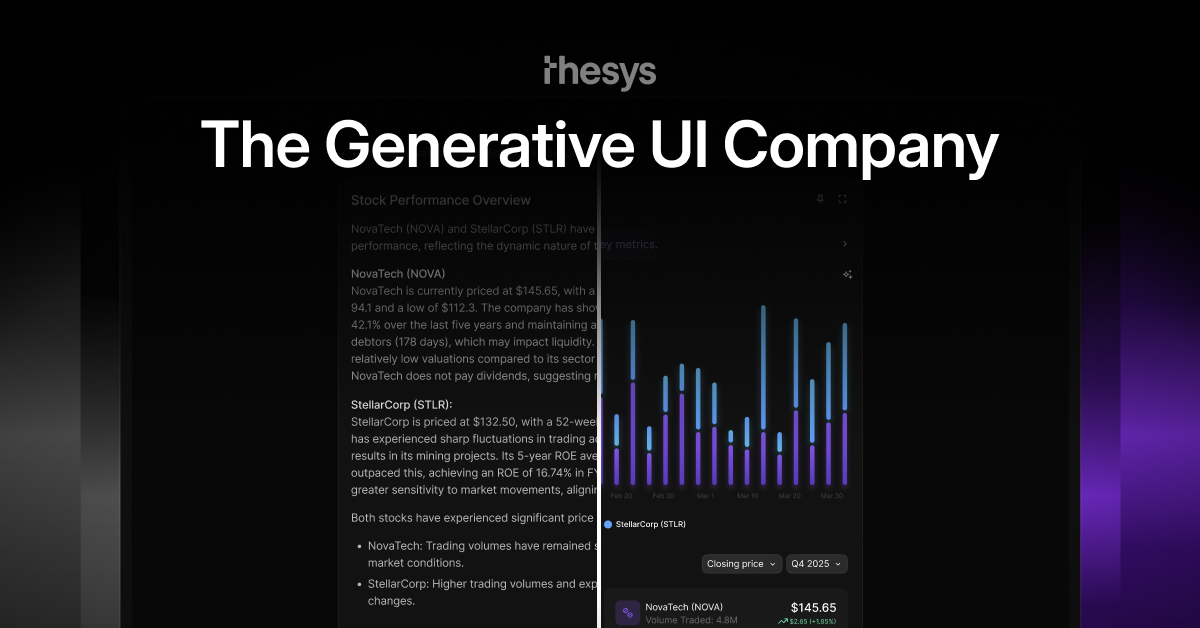

ThesysのC1は、この問題に正面から取り組んだAPIだ。LLMの応答をフォーム、チャート、テーブル、カードといったインタラクティブなUIコンポーネントにリアルタイムで変換する。日本語の紹介記事はまだ見当たらないが、海外ではProduct Huntで450アップボートを獲得し、OpenUIフレームワークはGitHubで3,500スターを集めている。

2行で何が変わるか

C1の統合方法が面白い。OpenAI互換APIとして設計されているため、既存のOpenAIクライアントのbase URLとAPIキーを差し替えるだけで動く。

client = OpenAI(

api_key=os.environ["THESYS_API_KEY"],

base_url="https://api.thesys.dev/v1/embed"

)

この2行の変更で、LLMの返答がテキストからUIに変わる。バックエンドのLLMはOpenAIでもClaudeでも何でもいい。C1はあくまでミドルウェアとして間に入り、テキスト応答をUIコンポーネントに変換する。

フロントエンドはReact SDKが用意されていて、<C1Component />を置くだけでUIが描画される。ストリーミングにも対応しており、トークンが到着すると同時にUIがプログレッシブに構築されていく。テキストが流れる代わりにチャートが徐々に形になる体験は、デモを見ると素直に「おっ」と思う。

トークン効率というもう一つの武器

ThesysはOpenUI Langというオープンソースのui記述言語も開発している。JSONの代替として設計され、トークン効率のベンチマークではJSON比で最大67%、YAML比で最大61%のトークン削減を実現する。

ダッシュボードや料金表のような深くネストされたUIでは最大3倍のトークン削減。LLMのAPIコストが直接減るため、大量リクエストを処理するアプリでは無視できない差になる。

何に使えるか

正直、チャットボットの見た目が良くなる程度なら大した話ではない。C1が効くのはもっと具体的な場面だ。

社内データ分析ツール。SQLの結果をLLMに解釈させてインタラクティブなダッシュボードを生成する。Eコマースの商品提案。テキストの羅列ではなく、画像・価格・レビューをカード形式で並べて比較できるUIをリアルタイムで生成する。医療データの可視化。検査結果をグラフで表示し、基準値からの逸脱を視覚的に示す。

いずれも「LLMの出力をそのまま見せたら使いにくいが、UIに変換すれば実用になる」ケースだ。

Agent Builderという機能もある。ノーコードでAIエージェントを構築し、そのエージェントの応答をUIで返す。開発者でなくてもGenerative UIの恩恵を受けられる入口として設計されている。

料金

| プラン | 価格 | 内容 |

|---|---|---|

| Essentials | 無料($10分のクレジット付き) | 従量課金(月5,000APIコールまで無料) |

| Pay As You Go | 従量 | 優先推論、高スループット、プレミアムサポート |

| Enterprise | カスタム | プライベートデプロイ、SOC2/GDPR対応 |

スタートアップとしては妥当な価格設計。試すだけなら無料で始められる。

気になるところ

C1は現時点ではReact前提だ。Vue、Svelte、あるいはモバイルアプリで使いたい場合は対応を待つ必要がある。

また、UIの品質はLLMのプロンプト設計に大きく依存する。C1はあくまでLLMが出力した構造データをUIに変換する層であって、LLMが的外れな回答をすれば的外れなUIが生成される。「UIの形をした幻覚」が生まれる可能性がある点は理解しておく必要がある。

$4Mのシードラウンド(Together Fund主導)で開発を続けている段階で、長期的な安定性については未知数だ。ただ、300以上のチームが導入済みという数字は、プロダクト・マーケット・フィットを掴みつつあることを示している。

Generative UIという新カテゴリ

Vercel AI SDKにもGenerative UIの機能はあるが、Next.js/Vercelスタックとの深い結合が前提だ。C1はフレームワーク非依存のAPIミドルウェアとして設計されており、既存のどんなLLMアプリにも2行で差し込める。このアプローチの違いが、C1の独自の立ち位置を作っている。

「LLMが賢くなればなるほど、出力のUIが追いつかない」という問題は今後さらに大きくなる。C1はその問題を最もシンプルに解決する手段の一つだと思う。使うかどうかは別として、Generative UIというカテゴリ自体は覚えておいて損はない。

関連記事

Claude Codeの権限プロンプト、もう見逃さない — macOSのノッチに常駐するX Island

X IslandはmacOSのノッチ(Dynamic Island風)にAIコーディングエージェントの状態を表示する無料アプリ。Claude Code・Codex・Geminiに対応。導入方法と使い所を紹介。

35Bのモデルが3B分のメモリで動く — Qwen3.6-35B-A3BをMacで試す

Qwen3.6-35B-A3Bは35Bパラメータのうち3Bだけ使う超効率MoEモデル。SWE-bench 73.4%の実力をOllamaでローカル実行する方法、27B Dense版との違いを解説。

Claude Codeを放置するための道具ができた — CC-BEEPERというレトロなページャー

CC-BEEPERはClaude Code専用のmacOSフローティングウィジェット。進捗確認、自動承認、音声入力をレトロなページャーUIで提供。使い方と所感を紹介する。