AIが昨日の会話を覚えている — Qwen Codeのセッション横断メモリが地味にすごい

コーディングAIの面倒なところは、毎回同じ説明をさせられることだ。「このプロジェクトはTypeScriptで書いてる」「テストはVitest」「インポートは絶対パス」。Claude Codeなら CLAUDE.md に書いておけばいいが、それも手動でメンテするのは地味に面倒。

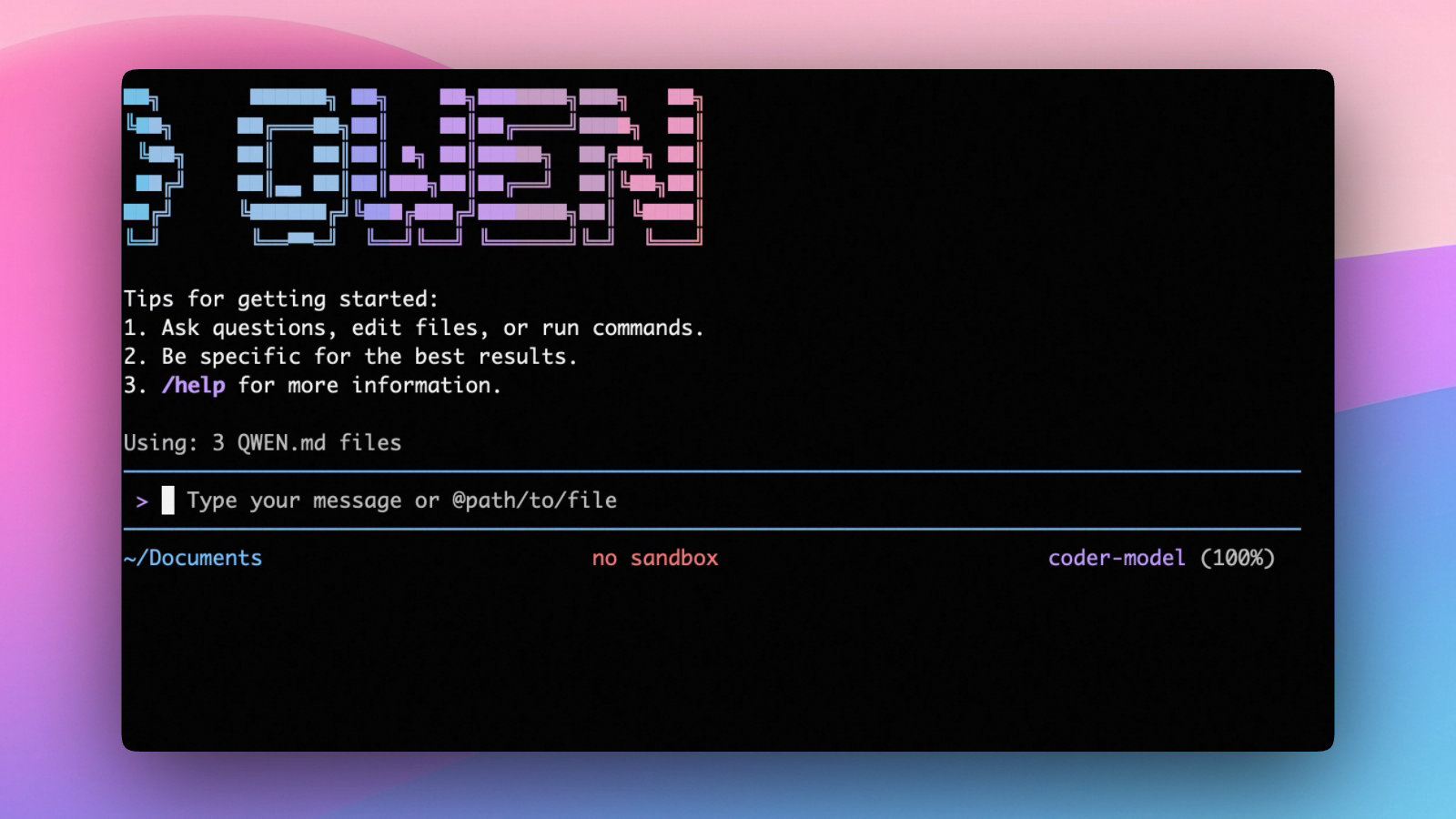

Qwen Code v0.15.0(4月23日リリース)は、これを自動化した。

セッション横断メモリとは

従来のコーディングCLIは、セッションを閉じたら全部忘れる。次に起動したら白紙。Qwen Code v0.15.0は会話の中から「記憶すべき情報」を自動抽出し、永続メモリとして保存する。

具体的には、技術スタック、コーディング規約、プロジェクト構造、よく使うパターンなどを推論で判断し、次のセッション起動時に自動でコンテキストに含める。

さらに「Auto-Dream」と呼ばれる整理機構が定期的に動き、重複する記憶のマージ、古くなった情報の剪定を行う。手動でルールファイルを書く必要がなくなる、というのが売り文句だ。

Claude Codeとの違い

Claude Codeにも memory コマンドでの記憶機能はある。ただし Claude Code のメモリは「ユーザーが明示的に保存を指示する」か「auto memory設定でClaude側が判断する」仕組み。保存のトリガーと粒度はまだ発展途上という印象。

Qwen Codeのアプローチは「全部自動で拾い、後から整理する」。より積極的で、ユーザーが何も意識しなくても勝手にプロジェクト知識を蓄積する。QWEN.mdのような手動ルールファイルを一切書かずに済むのは、特にプロジェクトを掛け持ちしている人にとって楽。

ただし、これが正しく動くかはモデルの推論精度に依存する。的外れな情報を「重要」と判断して覚えてしまうリスクもある。

その他のv0.15.0ハイライト

/batchコマンド。 複数ファイルを並列処理する。リントの一括修正、全ファイルへの同一変更の適用に使える。20ファイルのimport修正を1コマンドで回せるのは実用的。

サブエージェントのバックグラウンド実行。 CI/CDパイプラインにQwen Codeを組み込む際、UIなしで動かせる。テスト生成やドキュメント更新を自動化する道が開ける。

/doctorコマンド。 MCPサーバーの接続問題、設定ミス、ネットワークエラーをワンクリックで診断。環境構築で詰まる時間を減らしてくれる。

PDFとJupyter対応。 PDFからテキスト抽出(ページ範囲指定可)、Jupyterノートブックのセル表示。データサイエンス寄りのワークフローを意識した追加。

料金と制約

Qwen Code自体はオープンソース(GitHubで公開)で無料。ただしバックエンドのAPIは有料になった。以前あった無料OAuth枠(60リクエスト/分)は4月15日に廃止されている。

現在の選択肢は3つ:

- Alibaba Cloud Coding Plan(有料サブスク)— Qwen3-Coderをネイティブに使える

- OpenRouter / Fireworks AI経由 — 従量課金

- 自前のAPIキー — OpenAI、Anthropic、Gemini互換エンドポイント

つまり「ツールは無料だがモデル代はかかる」。Claude Code(月$20のProプランで使い放題)やCursor(月$20)と比べると、ランニングコストの見通しが立ちにくいのが弱点。ただしDeepSeekやローカルモデルを指定すれば極端にコストを抑えることもできるので、設定次第。

何が実現できるか

セッション横断メモリの本質的な価値は「プロジェクトのオンボーディングが不要になる」ことだ。新しいメンバーがQwen Codeを使い始めたとき、既存チームの蓄積されたメモリを共有すれば、コーディング規約やアーキテクチャの説明をスキップできる可能性がある。

/batchとサブエージェントの組み合わせも地味に強力。「100ファイルのTypeScript strictモード対応」のようなリファクタリングを、人間がPRを出す前にCIで自動実行し、結果だけレビューする運用が組める。

OSS版のGemini CLIをフォークして作られているため、拡張性も高い。MCP対応済みで、Figma MCPやGitHub MCPとの組み合わせも動く。

関連記事

月$20のClaude Codeに対抗馬が現れた — 無料で使えるQwen Codeの実力

AlibabaのQwenチームが開発するオープンソースCLIコーディングエージェント「Qwen Code」。Claude CodeやCodex CLIとの違い、機能、使い方を整理する。

コーディングAIを「クラウドに放り投げる」時代が来た — Mistral Medium 3.5とVibe Remote Agentsの正体

Mistral AIが128B旗艦モデル「Medium 3.5」とクラウド非同期コーディング「Vibe Remote Agents」を発表。SWE-Bench 77.6%、256kコンテキスト、オープンウェイト。性能・料金・使い方を解説。

DeepSeek V4が正式公開。入力$0.14、Apache 2.0 — 「安すぎて怖い」は本当か

DeepSeek V4 ProとFlashが正式ローンチ。1.6TパラメータMoEでGPT-5.4・Claude Opus 4.6級の性能を、入力$0.14〜$1.74で提供。ベンチマーク・料金・実用性を整理する。