NVIDIAの次世代AI基盤「Vera Rubin」の中身 — 3360億トランジスタ、6チップ構成の意味

NVIDIAがGTC 2026で、次のAI計算基盤「Vera Rubin」をお披露目した。Blackwellの後を継ぐフラッグシップで、アーキテクチャ名は天文学者ヴェラ・ルービン(銀河の回転運動から暗黒物質の存在を示唆した人物)にちなんでいる。名前そのものは2024年のCOMPUTEXで一度予告されていたが、今回のGTCで中身が一気に具体化した。

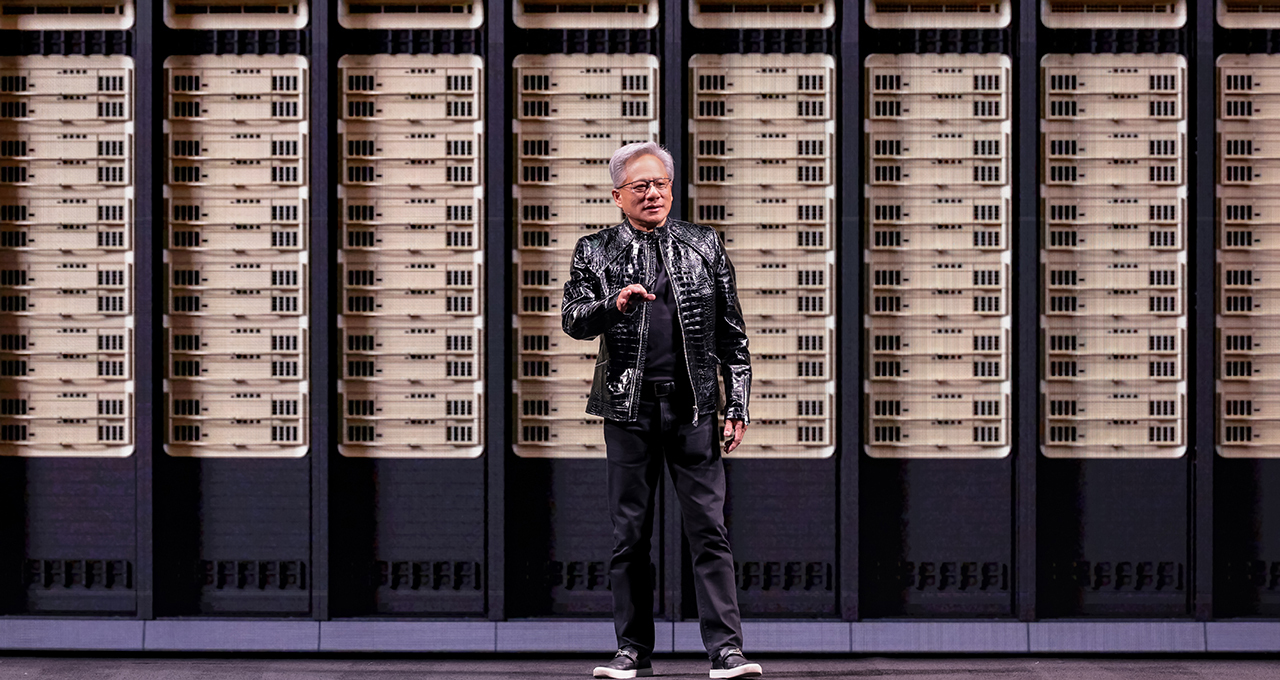

一言でいえば、Vera Rubinは「GPU 1枚の性能競争」から「ラック丸ごと + ネットワーク + 電力 + ソフトウェアをフルスタックで出荷する」という方向にNVIDIAが完全に舵を切った、その宣言だ。Jensen Huang CEOが基調講演で繰り返した「エージェンティックAIの変曲点(inflection point)」という言葉は、要するに推論需要が学習需要を追い越す局面で、NVIDIAはラック単位で勝負するという意思表示である。

Rubin GPU単体のスペック

まず心臓部のRubin GPUから。これ単体でもかなり化け物だ。

- トランジスタ数: 3360億(Blackwellの2080億から約1.6倍)

- 製造プロセス: TSMC N3/N3P(3nm世代)

- 設計: レチクルサイズのダイを2枚組み合わせたデュアルダイ

- メモリ: HBM4を最大288GB、帯域22 TB/s

- 推論性能: 最大50 PFLOPs(NVFP4)

- 学習性能: 最大35 PFLOPs(NVFP4)

NVFP4というのは、NVIDIAが推論用に新しく使い始めた4ビット浮動小数点フォーマットで、精度をほとんど落とさずに計算量を圧縮できる。これをベースにした数字なので、FP8やBF16での数字とは直接比較できない点は注意が必要だ。

それでもNVIDIAが示したスライドでは、推論で約5倍、学習で約3.5倍という倍率がBlackwell比で示されている。CUDAコアの数や型の違いを割り引いても、世代交代としてはかなり攻めた伸びだ。

「6つのチップ」のフルスタック

今回NVIDIAが強調したのは、Rubinを単体のGPUではなく、**6〜7チップ構成の「プラットフォーム」**として語ったことだ。構成はざっくりこうなっている。

- Vera CPU — Grace後継のArmベースCPU。Rubinとコヒーレント接続

- Rubin GPU — 前述の3360億トランジスタ・HBM4搭載

- Rubin CPX — 巨大コンテキスト推論専用の新種GPU。長文コンテキストに最適化

- 次世代DPU — データパス・ストレージ・ネットワーク処理を専用化

- NIC — スケールアウト通信用

- NVLink 6 スイッチ — スケールアップ用、260 TB/sオーダーのラック内帯域

このうち、**Rubin CPX(Context Processor eXtended)**が個人的にはいちばん面白いと思っている。LLMの推論で「プロンプトを詰め込む最初の一発目」と「生成中の逐次計算」は性質がまったく違う。前者は膨大な並列計算でメモリ帯域が効き、後者は小さな計算を高頻度で回すレイテンシ勝負だ。Rubin CPXはこの「前段のプリフィル」を別チップで受け持つことで、Rubin GPU本体を逐次生成に専念させる、という役割分担を狙っている。

要するに、コンテキスト長が100万トークンを超えても、前処理で詰まらない設計になっている。1M〜2Mトークンのコンテキストウィンドウが当たり前になった2026年の状況に対して、ハードウェア側から「それはCPXでやります」と答えを出しにきた格好だ。

Vera Rubin NVL72ラック — 1ラックで一つの巨大GPU

NVIDIAの看板商品のひとつが、Rubin GPUを72枚・Vera CPUを36個まとめたVera Rubin NVL72ラックだ。スケールアップ帯域は260 TB/s。要するに、ラック内の全GPUがNVLinkで高速接続され、プログラムから見ると1枚の巨大GPUのように振る舞う。

この「ラック=1GPU」という抽象化は、Grace Blackwell NVL72(Blackwell世代)からの正統進化だが、Rubinでは帯域が大幅に増えたことで、1兆パラメータ超のモデルを1ラックに収めても、ラック内通信が律速にならない領域に入ってきた。MoE(Mixture of Experts)型の巨大モデルが本格的に商用化される2026年後半以降、この帯域差は結構効いてくるはずだ。

Microsoft AzureとCoreWeaveが初期の導入パートナーとしてすでに発表されている。日本国内ではさくらインターネットやソフトバンクがBlackwell世代の大規模調達を進めてきた文脈があるので、Vera Rubin世代でも国内クラウド事業者の動きは早いと見ている。

デスクサイドで1兆パラメータを動かす「DGX Station GB300」

もう一つ発表で目立ったのが、DGX Station GB300。こちらはデータセンター向けではなく、「デスクサイドに置ける1兆パラメータ対応マシン」という触れ込みだ。スペックは:

- コヒーレントメモリ 748GB

- AI演算性能 最大20 PFLOPs

- 最大1兆パラメータの推論モデルをローカルで実行可能

つまり、研究者やパワーユーザーが自分の机の横に置いて、オフラインで大型LLMを叩ける。さすがに消費電力と発熱は一般オフィスには厳しいだろうが、「オンプレで完結するAI開発環境」を欲しがっている大企業や政府機関にはハマる商品だ。

筆者の感覚だと、これは「個人ユース」というよりも、セキュリティ要件が高くて外部クラウドに出せないデータを扱う組織が、オンプレAI基盤を整えるための入口という位置づけに見える。医療、金融、防衛、政府——このあたりは、クラウド経由でLLMを叩きたくない案件を山のように抱えている。

何が変わるのか — 筆者の見立て

仕様表を追うのはここまでにして、Vera Rubinが出てきたことで実際に何が変わりそうなのか。3つに絞って書いておく。

1つ目は、推論コストの相場が動く可能性だ。推論性能がBlackwell比で5倍という数字が事実なら、単純計算で「同じ推論を5分の1の電力・5分の1のチップ数」でこなせる。これが現実の料金に反映されるのは早くて2026年末〜2027年前半になるが、LLM APIの価格競争はここから一段深くなる。OpenAIやAnthropicの従量課金が下がる余地が、また一段出てくるはずだ。

2つ目は、長いコンテキストの「現実的な実用範囲」が広がること。Rubin CPXがプリフィルを専用処理することで、1Mトークン・2Mトークンといったコンテキストがレイテンシ的にも料金的にも現実解になる。たとえば、企業の全ドキュメントをRAGなしでそのまま食わせて質問する、という使い方が「1回のAPIコールで5秒」レベルになってくると、ワークフロー設計そのものが変わる。エンジニアリング的には、「RAGパイプラインを頑張るよりも、コンテキストに全部放り込んだほうが速い」みたいな逆転が実際に起きる可能性がある。

3つ目は、オンプレAIインフラの選択肢が現実的になること。DGX Station GB300のような「1ラック / 1ボックスで完結するハードウェア」が出揃うと、「AIは全部クラウドで十分」という前提が崩れる層が一定数出てくる。特に、データ主権(sovereignty)や規制対応を理由にクラウドを使えない業種にとっては、ここで選択肢が広がる意味は大きい。日本のエンタープライズ市場の動きにも影響しそうだ。

冷静に見るべきところ

いい話ばかりではない。いくつか注意しておきたい点もある。

まず、Vera Rubinの「商用出荷」は2026年後半だ。今回のGTCで示されたのは仕様・設計・初期パートナーであって、実際にクラウド事業者のインスタンスとして使えるのはもう少し先になる。早期利用を狙うなら、H200やB200(Blackwell)からの乗り換え計画を急ぐというよりは、「ちゃんと待ちながら調達スケジュールを組み直す」のが現実的だ。

次に、電力と冷却のハードルが上がる。Rubin GPU単体の消費電力はBlackwellよりも確実に上がっており、空冷では間に合わない。液冷前提のデータセンターでないとそもそも置けない、という状況になる。日本の既存データセンターの多くは空冷ベースで、液冷対応を進めている施設はまだ限られる。つまり「Rubinを動かすデータセンターが国内にどれだけあるか」というインフラ側の話が、2027年に向けてボトルネックになる可能性がある。

そして、価格も確実に上がる。Blackwell世代ですでに「GPUが買えない」「1年待ち」と言われていたのが、Rubin世代ではさらに希少・高額になる。Huang CEOが基調講演で「2025〜2027年の間に1兆ドル分のGPU受注」と言い切った背景には、需要に対する供給が根本的に足りていないという現実がある。中小企業や個人研究者が直接手を出せる領域ではない。

AIインフラの主戦場が「チップ単体」から「ラック丸ごと」に移った

最後にひとつだけまとめておくと、今回のVera Rubin発表で一番大事なのは、スペック表の数字そのものよりも、NVIDIAが「ラック単位でしか勝負しない」と明言したことだと思っている。

過去10年のGPU進化は「1枚の性能を上げる」が主戦場だった。しかしRubin世代では、GPU・CPU・CPX・DPU・NIC・スイッチ・電源・冷却・ソフトウェアまで、全部まとめて出荷する。そして、その恩恵を受けるには、ラックごとNVIDIAのエコシステムを丸呑みする必要がある。

AMDがInstinct MI400で対抗を試みているものの、「ラック丸ごとのフルスタック対抗プラットフォーム」でNVIDIAに真正面から当てられる会社は、正直まだ見当たらない。Vera Rubinの発表は、NVIDIAの独占的な立ち位置をもう一段強化する効果があったと見ている。

AI業界の読者にとって直接の影響は、おそらくLLMのAPI料金と、推論の待ち時間、そしてコンテキスト長の「気にせず使える上限」として跳ね返ってくる。ハードウェアの話に見えて、実はプロンプトの書き方やアプリ設計にまで影響する話、というのがVera Rubinの本当の意味だ。

関連記事

中国のAI推論チップが量産に入った — Ascend 950PRが崩しにかかっているもの

HuaweiのAscend 950PRが2026年4月量産開始。1.56 PFLOPS FP4性能でH20の約2.8倍、DeepSeek V4の主実行基盤、ByteDance/Alibaba/Tencentから計75万ユニットの発注。NVIDIA依存脱却の現実味を整理する。

$20Bでチップ技術をNVIDIAに売った会社が、$650Mで「第二の人生」を始める — Groqネオクラウドの賭け

AIチップ企業Groqが$20BでNVIDIAに技術をライセンスした後、$650M調達でAI推論ネオクラウドへ転換。Groq2の戦略と推論市場の構造変化を解説する。

1枚のチップが皿ほどの大きさ — NVIDIAに挑むAI半導体Cerebrasが上場申請、時価総額5.6兆円を狙う

Cerebras SystemsがNasdaq上場を申請。WSE-3チップの技術的優位性、OpenAI・AWS大型契約、売上5.1億ドルの成長実績とNVIDIA一強への挑戦を解説。